Ilustración: Jhojan Millán - @alverja.caricatura

El 9 de julio una usuaria de Twitter (ahora X) publicó un hilo en el que muestra los resultados de haberle preguntado a una Inteligencia Artificial (IA) cómo se verían las Barbies de distintas ciudades de Colombia. Entre el 10 de julio y el 1 de agosto se publicaron al menos 18 notas en medios de comunicación replicando esta información: Semana, El Tiempo, Blue Radio, La FM, El Heraldo y W Radio fueron algunos de ellos.

Este es solo un ejemplo de múltiples casos en que los medios de comunicación usan la información generada por la IA como material de publicación, haciéndole preguntas como cuáles son los pueblos o parques más lindos de Antioquia y Colombia, predicciones sobre el fin de la humanidad, soluciones o previsiones sobre el cambio climático o "desentrañar la incógnita ancestral” de si fue primero el huevo o la gallina. Sin embargo, conocedores del tema indican que las IAs generativas de modelo de lenguaje como ChatGPT no están diseñadas para esto.

Las inteligencias artificiales generativas

El 30 de noviembre de 2022 Open AI lanzó ChatGPT. A partir de este lanzamiento, otras plataformas como Google o Bing se sumaron al mercado incluyendo las inteligencias artificiales en sus motores de búsqueda para optimizar la experiencia de los usuarios. Pero esto no quiere decir que las inteligencias artificiales iniciaran con ChatGPT: al menos desde 1956 se está hablando de inteligencia artificial, pero Open AI fue la primera empresa en ofrecer el acceso gratuito para los usuarios.

Según Víctor Vallejo, psicólogo y lingüista computacional de la Universidad de Antioquia, el uso de ChatGPT no es completamente gratuito, pues se sirve de la interacción de los usuarios para entrenarse en una lógica similar a las redes sociales: gratuidad a cambio de datos.

Vallejo agregó que para la generación de contenidos con inteligencia artificial hay que tener en cuenta el “sesgo cognitivo” o de programación: las inteligencias artificiales generativas comparten las lógicas neuronales de los seres cognitivos, como los humanos, en su entrenamiento. Así, plantea que “los sesgos cognitivos se pueden referir a las tendencias, inclinaciones, interpretaciones y conclusiones que omiten aspectos de la información en función de una valoración”.

Esto puede pasar por condiciones intelectuales, emocionales o fisiológicas que afectan la percepción de la información. Por ejemplo, estar enamorado o tener hambre afecta cómo nos relacionamos con una persona.

Un ejemplo de esto es el sesgo que se crea cuando nos quemamos y optamos por, en caso de volverse a presentar la posibilidad, evitar el contacto con la llama. Otro ejemplo podría ser cuando establecemos rutas para llegar de A a B según criterios de velocidad, seguridad o costumbre.

Las inteligencias artificiales generativas conversacionales, como ChatGPT, funcionan como una red neuronal: a partir de los entrenamientos y de la información que se le da, la IA genera redes de información a partir de la predicción y, por medio de la supervisión por parte de ingenieros y expertos y a través de la repetición de esas conexiones, se refuerzan las respuestas más cercanas a un “ideal”.

Según el profesor, en este punto existen varios problemas. Lo primero es que las IAs tienen un rango de temas muy amplio para la generación de estas conversaciones, por lo que su entrenamiento se dificulta y muchas de sus respuestas no están afinadas. Por otro lado, está la complejidad y la polémica que conlleva tratar temas humanos.

Vallejo explicó que “hay unos principios que los ingenieros y sus asesores tratan de establecer: que la IA sea amable, que evite temas polémicos, que procure ciertos valores que consideramos más deseables. Aquí ya hay un sesgo ideológico. Podemos esperar que muchas IAs tiendan a valores liberales, valores de izquierda, que procuran el respeto por la diferencia y la diversidad en oposición a valores más conservadores”, agregó.

Escuche aquí la explicación completa, con ejemplos, del sesgo cognitivo.

¿Ǫué tiene que ver esto con las noticias?

El País de Cali publicó el 5 de agosto un artículo con el siguiente titular: “Desentrañando la incógnita ancestral: ChatGPT explica quién surgió primero ¿el huevo o la gallina?”. Esta nota expone las respuestas dadas por la inteligencia artificial a esa pregunta. Al final hay una nota que dice que el artículo se creó con apoyo de una inteligencia artificial y lo curó un periodista especializado de ese medio.

Diana Ramírez, coordinadora del pregrado de Periodismo de la Universidad de Antioquia y estudiante del doctorado en Comunicaciones y Narrativas de la misma universidad, ha realizado experimentación con ChatGPT como coeditor en la creación de productos informativos como noticias. Partiendo de la nota de El País, explicó que en esta se usa la inteligencia artificial de dos formas diferentes: como fuente de información y como ayudante de redacción.

Sobre lo primero, según ella, “no tiene justificación ni esta ni ninguna noticia en la que se le haga a ChatGPT o a otra inteligencia artificial similar cualquier pregunta”. Agregó que “no es una fuente confiable de información y, a pesar de que está alimentada por millones de datos, al igual que Bing o Bard, no son datos que estén curados o que pasen por el criterio de qué es verdad y qué no”.

Sobre esto, el profesor Vallejo explicó que “cuando se le plantea una pregunta a la inteligencia artificial se le da un contexto para que responda poniendo una palabra tras otra a partir de cuál es la probabilidad de que una palabra siga a la otra. Esa probabilidad se establece con los textos con que fue alimentada la IA”.

Ramírez planteó que “es cuestionable que los periodistas estén acudiendo a este tipo de tecnologías o herramientas sin saber cuál es su uso o sus alcances, y que estén divulgando información basados en ella”.

Sobre lo segundo, su uso como apoyo a la redacción, expresó que “la aparición de ChatGPT introduce la popularización de la herramienta, pero no existe una apropiación tecnológica adecuada. Hubo una masificación, y no es que esté mal que se masifique, pero no hay una reflexión sobre las posibilidades de la inteligencia artificial y lo que implica en un ejercicio que debe ser tan crítico como el periodístico”.

Ilustración: Jhojan Millán - @alverja.caricatura

¿Ǫué está pasando en los medios?

Sebastián Ramírez, periodista de Semana, explicó que los temas en este medio “funcionan a partir del tráfico, es decir, usan múltiples herramientas para identificar qué es lo que busca con mayor frecuencia la gente en Google”. y, a partir de esto, el medio hace recomendaciones, “muchas recomendaciones”, a los periodistas, en las que incluye hablar sobre inteligencias artificiales.

La profesora Diana Ramírez confirma esto. Advirtió que, además de ser herramientas novedosas, las inteligencias artificiales son tendencia por sí mismas y no se diferencia de otros temas de entretenimiento; así, cualquier tema relacionado con ellas significa una gran posibilidad de generar clics. De hecho, según Similarweb, Open AI es la cuarta página de tecnología más visitada en Estados Unidos.

Por su parte, Danilo Arias, periodista de El País de Cali, dice que el principal uso que le da a la inteligencia artificial es como coeditora en la redacción, pero también como fuente de contenidos: “Hay asuntos que no son relevantes (beneficios de la papaya o del jugo de guayaba en ayunas), pero que generan tráfico y en los que la IA te puede soltar definiciones, causas, consecuencias y cosas básicas pero fundamentales para armar la nota. Es cuestión de verificar y corregir la redacción que pueda ser redundante o incoherente”.

Esta perspectiva la comparte Cristian Serrano, periodista de la sección de Tecnología de Semana, quien dijo que las inteligencias artificiales son muy útiles cuando se tratan “temas light, como qué té sirve para dormir mejor en las noches”. Pero, por otro lado, Serrano afirmó que las noticias de “dijo la IA” surgen de una experimentación haciéndole preguntas para ver qué responde. Aclaró que publicar lo que dijo la inteligencia artificial no implica validar que la información sea verdadera o falsa. Simplemente es lo que dice la IA.

¿Ǫué dice ChatGPT?

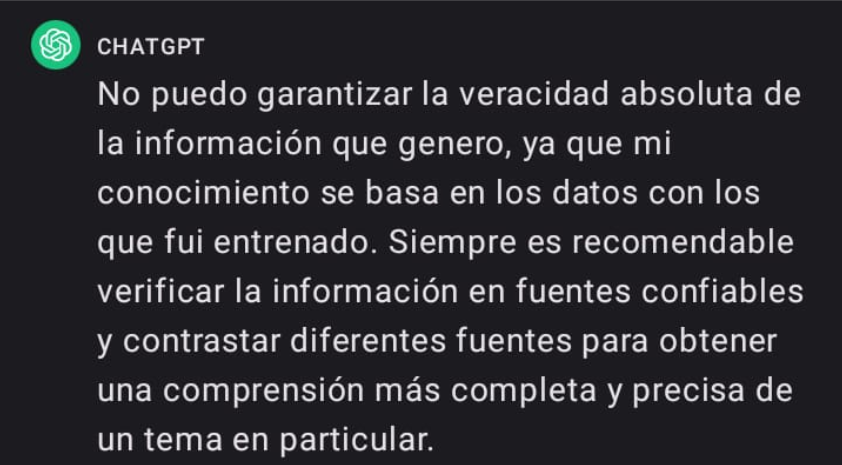

Según Open AI, la información que tiene ChatGPT sobre sí misma es precisa en términos generales: sabe qué es, cómo funciona, cuáles son sus posibilidades y reconoce sus sesgos. Partiendo de esto, le pregunté a la IA si puede garantizar que la información generada por sí misma sea verdadera o falsa y respondió lo siguiente: “No puedo garantizar la veracidad absoluta de la información que genero, ya que mi conocimiento se basa en los datos con los que fui entrenado. Siempre es recomendable verificar la información en fuentes confiables y contrastar diferentes fuentes para obtener una comprensión más completa y precisa de un tema en particular”.

Imagen propia. Captura de la conversación con ChatGPT.